过拟合

参数太多而样本数不够容易发生过拟合。

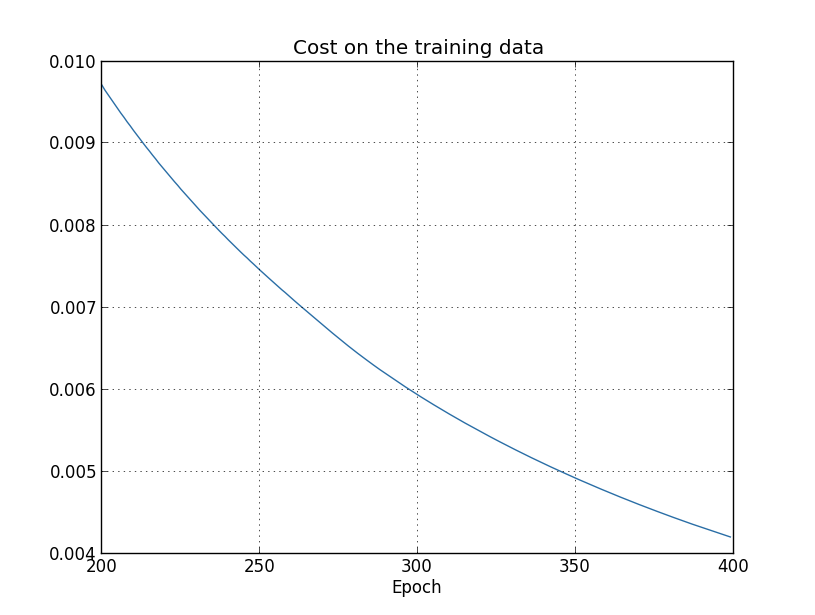

过拟合的表现

训练样本的Cost持续下降,而测试样本的Cost下降到一定程度开始反弹。

训练样本的准确率达到100%,而测试样本的准确率与训练样本有较大差距。

未发生过拟合的情况下,训练样本的结果与测试样本的结果应该趋势相同,差别不大。

怎样解决过拟合

验证数据集 + early stopping策略

具体方法是:

(1)选择一组超参数

(2)使用训练数据集训练模型

(3)每训练完一个迭代,就用验证数据集计算cost,观察是否“饱和”。

(4)如果未饱和,重复步骤2-3。如果已饱和,针对这组超参数的训练结束。重新选择一组超参数进行2-3步。

(5)选择效果最好的一组超参数训练出的模型,用测试数据测试模型的效果。

验证数据集的作用:

(1)用于early stopping策略

(2)选择超参数

(3)防止模型在测试数据上过拟合

增大训练数据集

缺点:训练数据需要成本

减小网络大小

缺点:更大的网络更powerful

正则化

Last updated