5-10 线性回归的可解释性和更多思考

import matplotlib.pyplot as plt

from sklearn import datasets

boston = datasets.load_boston()

X = boston.data

y = boston.target

X = X[y < 50.0]

y = y[y < 50.0]

from sklearn.linear_model import LinearRegression

lin_reg = LinearRegression()

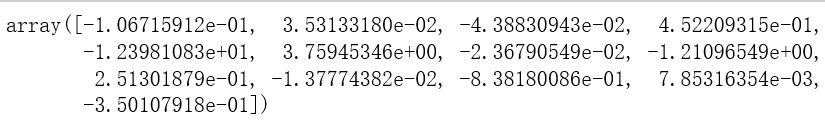

lin_reg.fit(X, y)

lin_reg.coef_array(['NOX', 'DIS', 'PTRATIO', 'LSTAT', 'CRIM', 'INDUS', 'AGE', 'TAX', 'B', 'ZN', 'RAD', 'CHAS', 'RM'], dtype='<U7')

线性回归算法的总结

Last updated